$\newcommand{\lnl}{\\[8pt]}$

$\newcommand{\Lnl}{\\[18pt]}$

$\newcommand{\delt}{\mathrm{d}}$

$\newcommand{\comb}{\mathrm{C}}$

$\DeclareMathOperator*{\ssum}{\Sigma}$

$\DeclareMathOperator*{\sprod}{\Pi}$

「分散」のページで書いた通り, 2つの確率変数$X,Y$が独立な場合は,

V(X+Y) = V(X) + V(Y)\label{eq-ind}

\end{align}

が成り立ちます.

では,独立ではない場合はどのような値になるのでしょうか.

共分散

$X,Y$を確率変数とし,期待値も分散も存在するとします.分散の定義に従って, $X+Y$の分散を計算してみましょう.

分散の計算には$V(X+Y) = E\big((X+Y)^2\big) – E(X+Y)^2$を使うと便利です.

E(X+Y) &= E(X) + E(Y)\lnl

E(X+Y)^2 &= E(X)^2 + 2E(X)E(Y) + E(Y)^2\lnl

E\big((X+Y)^2\big) &= E(X^2 + 2XY + Y^2) \\

&=E(X^2) + 2E(XY) + E(Y^2)

\end{align}

ですので,

V&(X+Y) \\

&= E\big((X+Y)^2\big) – E(X+Y)^2\\

&=\Big(E(X^2) + 2E(XY) + E(Y^2)\Big) – \Big(E(X)^2 + 2E(X)E(Y) + E(Y)^2\Big)\\

&=\Big(E(X^2) – E(X)^2\Big) + \Big(E(Y^2) – E(Y)^2\Big) + 2\Big(E(XY) – E(X)E(Y) \Big)\\

&=V(X) + V(Y) + 2\Big( \underline{E(XY) – E(X)E(Y)} \Big)

\end{align}

これで分散が求まりました.ここで,下線部は「積の期待値と期待値の積の差」となっていますね.

これを共分散(Covariance)といい,$\mathrm{Cov}(X,Y)$や$\rho_{XY}$と表します.

つまり和の分散は,

V(X+Y) = V(X)+V(Y) + 2\mathrm{Cov}(X,Y)

\end{align}

と表されることになります.独立であれば,$E(XY) = E(X)E(Y)$なので$\mathrm{Cov}(X,Y)=0$になり$\eqref{eq-ind}$が成り立つことがわかりますね.

共分散$\mathrm{Cov}(X,Y)$を

\mathrm{Cov}(X,Y) = E\Big[ \big(X-E(X)\big)\big(Y-E(Y)\big)\Big]

\end{align}

で定義しても同じです.展開して線形性を使って整理すると同じ式になります.この定義のほうが分散の定義に似ていて共分散って感じでていますね.

この定義からわかるように,共分散は「$X$の各値と平均からのずれ」と「$Y$の各値と平均からのずれ」をかけたものの期待値です.つまり, 共分散が正だと$X-E(X)$と$Y-E(Y)$の符号は同じである傾向が強く, 共分散が負だと反対になる傾向が強いといえます.

相関係数

共分散はその符号で2つの確率変数間の平均からのずれがどのような傾向になるかを表す性質があると述べました.

しかし, 共分散の値は元の確率変数の単位に依存するため複数の確率変数のペア間で比較するには不向きです.

そこで共分散を標準偏差で割ることで確率変数のペア間で比べやすくしたものを相関係数(Correlation Coefficient)といい, $\rho_{XY}$や簡単に$\rho$と表します.

\rho_{XY} = \frac{\mathrm{Cov}(X,Y)}{\sqrt{V(X)}\sqrt{V(Y)}}

\end{align}

相関係数は必ず $-1\le \rho \le 1$の範囲に収まります.証明はシュワルツの不等式を使います.

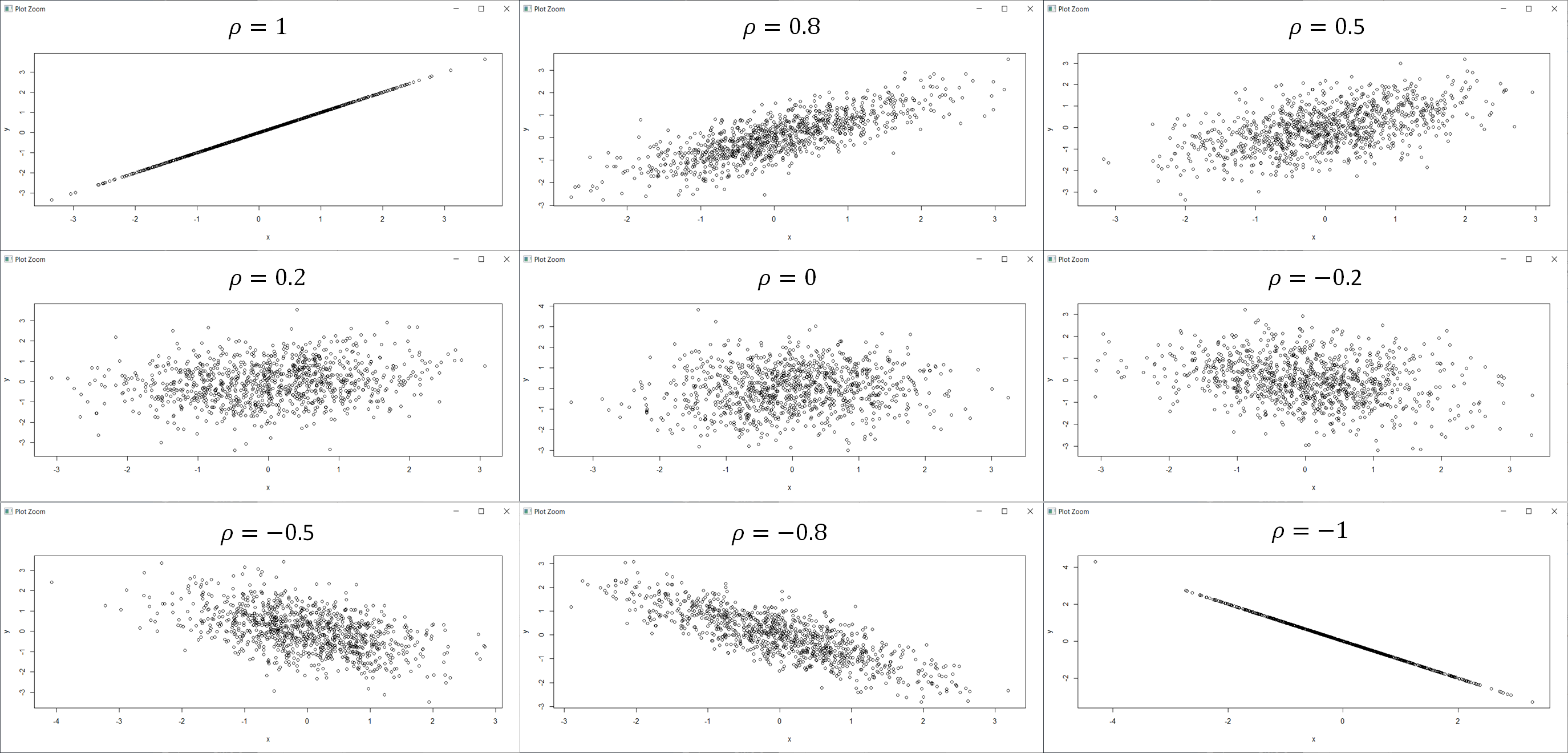

相関係数の値ごとの分布の様子

下図は相関係数を$1$~$-1$まで段階的に変化させたものをプロットしたものです.

$1$に近づけば近づくほど2つの確率変数の値は傾きが正の直線上に乗る.逆に$-1$に近づけば近づくほど傾きが負の直線上に乗る.ただし,傾きの大きさは関係なく,正負のみが関係します.

$\rho=0$のとき,2つの確率変数は無相関(Uncorrelated)といいます.独立であれば無相関ですが,無相関だからといって必ず独立であるとは言えません.